Введение в искусственные нейтральные сети | Комплект 1

Обучение ИНС устойчиво к ошибкам в обучающих данных и успешно применяется для изучения функций с действительными, дискретными и векторными значениями, содержащих такие проблемы, как интерпретация визуальных сцен, распознавание речи и обучение стратегиям управления роботами. Исследование искусственных нейронных сетей (ИНС) отчасти было вдохновлено наблюдением, что биологические обучающие системы построены из очень сложных сетей взаимосвязанных нейронов в мозге. Человеческий мозг содержит плотно взаимосвязанную сеть примерно из 10 ^ 11-10 ^ 12 нейронов, каждый из которых связан, в среднем, с 10 ^ 4-10 ^ 5 другими нейронами. Таким образом, в среднем человеческому мозгу требуется примерно 10 ^ -1, чтобы принимать удивительно сложные решения. Системы ИНС заинтересованы в захвате такого рода высокопараллельных вычислений на основе распределенных представлений. Как правило, ИНС строятся из плотно взаимосвязанного набора простых единиц, где каждая единица принимает ряд входных данных с действительным знаком и производит один выход с действительным знаком.

Но ИНС менее мотивированы биологическими нейронными системами, у биологических нейронных систем есть много сложностей, которые не моделируются ИНС. Некоторые из них показаны на рисунках.

Разница между биологическими нейронами и искусственными нейронами

| Биологические нейроны | Искусственные нейроны |

|---|---|

| Основные компоненты: аксионы, дендриты, синапсы. | Основные компоненты: узлы, входы, выходы, веса, смещение. |

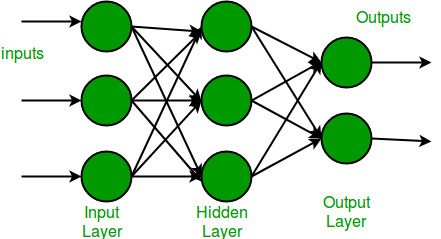

| Информация от других нейронов в виде электрических импульсов поступает в дендриты в точках соединения, называемых синапсами. Информация перетекает от дендритов к ячейке, где она обрабатывается. Выходной сигнал, последовательность импульсов, затем отправляется по аксону в синапсы других нейронов. | Устройства и связи нейронов составляют сеть и состоят из трех слоев. Первый слой называется входным и является единственным слоем, подверженным внешним сигналам. Входной слой передает сигналы нейронам следующего слоя, который называется скрытым слоем. Скрытый слой извлекает соответствующие особенности или шаблоны из полученных сигналов. Те функции или шаблоны, которые считаются важными, затем направляются на выходной уровень, который является последним уровнем сети. |

| Синапс может увеличивать или уменьшать силу связи. Здесь хранится информация. | Искусственные сигналы могут быть изменены весами аналогично физическим изменениям, происходящим в синапсах. |

| Около 10 11 нейронов. | 10 2 - 10 4 нейронов с современной технологией |

Разница между человеческим мозгом и компьютером в том, как обрабатывается информация.

| Человеческий мозг (биологическая нейронная сеть) | Компьютеры (искусственная нейронная сеть) |

|---|---|

| Человеческий мозг работает асинхронно | Компьютеры (ИНС) работают синхронно. |

| Биологические нейроны вычисляют медленно (несколько мс на вычисление) | Искусственные нейроны быстро вычисляют (<1 наносекунды на вычисление) |

| Мозг представляет информацию распределенным образом, потому что нейроны ненадежны и могут умереть в любой момент. | В компьютерных программах каждый бит должен работать так, как задумано, иначе эти программы вылетят из строя. |

| Наш мозг со временем меняет свои связи, чтобы отображать новую информацию и требования, предъявляемые к нам. | Связь между электронными компонентами компьютера никогда не изменится, если мы не заменим его компоненты. |

| Биологические нейронные сети имеют сложную топологию. | ИНС часто имеют древовидную структуру. |

| Исследователям еще предстоит выяснить, как на самом деле обучается мозг. | ИНС используют для обучения градиентный спуск. |

Преимущество использования искусственных нейронных сетей:

- Проблема в ИНС может иметь экземпляры, которые представлены множеством пар атрибут-значение.

- ИНС, используемые для задач с выходом целевой функции, могут быть дискретными, действительными или вектором из нескольких действительных или дискретных атрибутов.

- Методы обучения ИНС достаточно устойчивы к шуму в обучающих данных. Примеры обучения могут содержать ошибки, которые не влияют на конечный результат.

- Он обычно используется там, где может потребоваться быстрая оценка изученной целевой функции.

- ИНС могут выдерживать длительное время обучения в зависимости от таких факторов, как количество весов в сети, количество рассмотренных обучающих примеров и настройки различных параметров алгоритма обучения.

Модель нейрона Маккаллоха-Питтса:

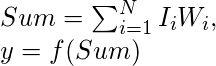

Ранняя модель искусственного нейрона была представлена Уорреном Маккалоком и Уолтером Питтсом в 1943 году. Нейронная модель Маккалока-Питтса также известна как линейный пороговый вентиль. Это нейрон из набора входов I1, I2,…, Im и одного выхода y. Линейный пороговый вентиль просто классифицирует набор входных данных на два разных класса. Таким образом, выход y является двоичным. Математически такую функцию можно описать с помощью следующих уравнений:

W1, W2, W3… .Wn - значения веса, нормализованные в диапазоне (0,1) или (-1,1) и связанные с каждой входной строкой, Sum - взвешенная сумма и пороговая константа. Функция f является линейной ступенчатой функцией на пороге

Однослойные нейронные сети (персептроны)

Входные данные многомерные (т.е. входные данные могут быть векторными):

вход x = (I1, I2, .., In)

Входные узлы (или блоки) подключены (обычно полностью) к узлу (или нескольким узлам) на следующем уровне. Узел следующего уровня принимает взвешенную сумму всех своих входов:

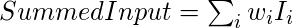

Правило:

Выходной узел имеет «порог» t.

Правило: Если суммирован ввод? t, затем он «срабатывает» (выход y = 1). Иначе (суммарный вход <t) он не срабатывает (выход y = 0).

Ограничения перцептронов:

(i) Выходные значения перцептрона могут принимать только одно из двух значений (0 или 1) из-за передаточной функции с жестким ограничением.

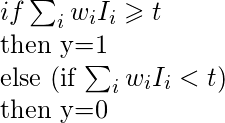

(ii) Персептроны могут классифицировать только линейно разделимые наборы векторов. Если можно нарисовать прямую линию или плоскость для разделения входных векторов на их правильные категории, входные векторы линейно разделимы. Если векторы не разделимы линейно, обучение никогда не достигнет точки, где все векторы будут правильно классифицированы.

Логическая функция XOR не является линейно разделимой (ее положительные и отрицательные экземпляры не могут быть разделены линией или гиперплоскостью). Следовательно, однослойный перцептрон никогда не сможет вычислить функцию XOR. Это большой недостаток, который когда-то привел к стагнации нейронных сетей. Но это было решено многослойно.

Многоуровневые нейронные сети

Многослойный персептрон (MLP) или многослойная нейронная сеть содержит один или несколько скрытых слоев (кроме одного входного и одного выходного слоя). В то время как однослойный персептрон может изучать только линейные функции, многослойный персептрон может также изучать нелинейные функции.

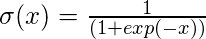

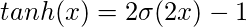

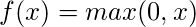

Этот нейрон принимает на вход x1, x2,…., X3 (и член смещения +1) и выводит f (суммарные входы + смещение), где f (.) Называется функцией активации. Основная функция Bias - предоставить каждому узлу обучаемое постоянное значение (в дополнение к обычным входным данным, которые этот узел получает). Каждая функция активации (или нелинейность) принимает одно число и выполняет над ним определенную фиксированную математическую операцию. Есть несколько функций активации, с которыми вы можете столкнуться на практике:

Сигмоид: принимает ввод с действительным знаком и сжимает его до диапазона от 0 до 1.

tanh: принимает ввод с действительным знаком и сжимает его до диапазона [-1, 1].

ReLu: ReLu означает выпрямленные линейные единицы. Он принимает ввод с действительным знаком и устанавливает его пороговое значение до 0 (заменяет отрицательные значения на 0).

Рекомендации:

- НЕЙРОННЫЕ СЕТИ Христос Стержиу и Димитриос Сиганос

- ujjwalkarn.me

- Машинное обучение, Том Митчелл, МакГроу Хилл, 1997.