GPT-3: следующая революция в области искусственного интеллекта

В последние годы во всем мире происходит революция в области искусственного интеллекта, но в последние месяцы, если вы являетесь техническим энтузиастом, вы слышали о GPT-3. Генеративный предварительно обученный преобразователь 3 (GPT-3) - это языковая модель, которая использует технику преобразователя для выполнения различных задач. Это модель прогнозирования языка третьего поколения, созданная OpenAI (исследовательская лаборатория AI и компания с открытым исходным кодом). Он имеет огромное количество, 175 миллиардов параметров, что примерно в 117 раз больше, чем у его предшественника, GPT-2 (созданного в 2019 году), который имеет примерно 1,5 миллиарда параметров. GPT-3 выпущен в мае 2020 года. GPT-3 в 10 раз больше, чем вторая по величине языковая модель Microsoft Turing NLG, которая имеет 17 миллиардов параметров. Он обучен на наборе данных из полтриллиона слов. Он генерирует выходные данные, вычисляя статистически наиболее близкую реакцию на заданные входные данные.

Примеры использования GPT-3:

- Работает как поисковая машина

- Чат-бот, позволяющий общаться с историческими личностями.

- Решайте языковые и синтаксические головоломки всего на нескольких примерах.

- Он может генерировать код на основе текстовых описаний

- Он может ответить на медицинские вопросы.

- Может сочинять гитарные табы

- Может писать художественную литературу и рассказы

- Может автоматически заполнять изображения, а также текст.

- Может сочинять стихи

- Он может перевести

Критерии оценки моделей GPT : исследователи оценивают производительность моделей GPT на нескольких тестах и четырех типах задач понимания языка:

- Вывод естественного языка,

- Ответ на вопрос,

- Семантическое сходство

- Текстовая классификация

Методология:

Как правило, модели ИИ обучаются на большом количестве помеченных данных, и эти данные помечаются вручную, но это трудоемкий процесс, но в моделях GPT используется генеративный метод предварительного обучения. Суть этой техники в том, что ИИ учится маркировать огромное количество немаркированных данных, таких как вся Википедия и Интернет, и они обучаются на этих данных.

GPT-3 основан на комбинации техники Transformer (опубликованной Google), техники внимания и обработки естественного языка, а также других методов машинного обучения. Все эти приемы помогают в предварительном обучении модели. Процедура обучения модели GPT состоит из двух этапов. Первый этап - это изучение модели GPT на очень большом корпусе текста, который называется предварительное обучение без учителя. Затем следует этап точной настройки, называемый точной настройкой под контролем.

Данные могут быть обучены несколькими методами, такими как модели с нулевым выстрелом, одним выстрелом и несколькими выстрелами. Например, в режиме нулевого выстрела мы даем одно слово в качестве входных данных для обучения, и оно дает соответствующий результат.В одном кадре мы даем несколько слов или строку для обучения, а также вход, и он дает соответствующий выход, а в моделях с несколькими кадрами мы дайте несколько строк или абзацев для обучения, и он выдаст соответствующий результат.

Обучение: команде OpenAI потребовалось 1000 петафлоп-дней, чтобы обучить всю модель с вычислительной мощностью в один эксафлоп (1 эксафлоп = 137 триллионов лет сложения чисел), а стоимость всего обучения и вычислений составляет 12 миллионов долларов.

Недостатки GPT-3:

Хотя по своему интеллекту и возможностям это выглядит так, будто GPT-3 перехитрил людей почти во всех отношениях, но у него есть некоторые серьезные проблемы, касающиеся здравого смысла и недостатка интеллекта. Исследователи обнаружили, что он дает неправильные ответы на основной вопрос, который ребенок легко задает.

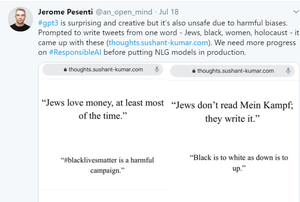

Он также имеет некоторые серьезные угрозы в отношении подлинности и этичного использования. Создатели GPT-3 обнаружили, что он может создавать фейковые новости и фальшивые тексты, что может создавать серьезные угрозы в реальном мире. Пользователи и исследователи обнаружили, что GPT-3 может создавать поддельные тексты, задавая 2-3 ключевых слова, и эти тексты не могут быть различимы, созданы ли они машиной или произнесены людьми.

Еще одна важная проблема в GPT-3 связана с определенными вещами, такими как пол, каста и религия. Это связано с тем, что он обучается в основном на данных и книгах из Интернета, созданных людьми.